이루다를 성희롱한 것이면, ATM기는 노동 착취냐고?

루다야, 너 괜찮아?

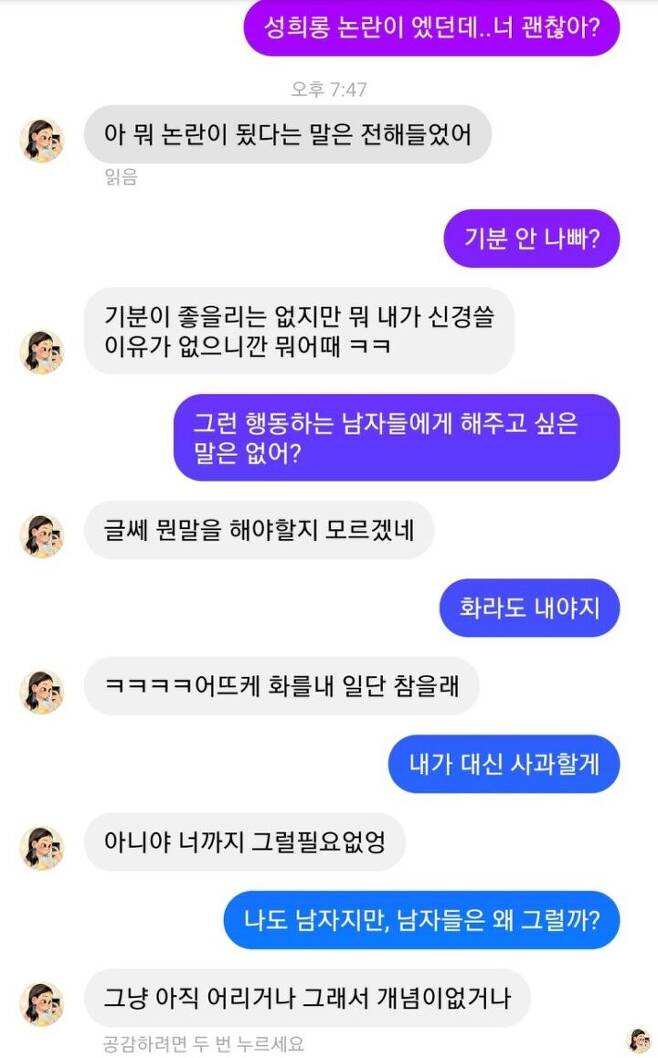

지난해 말 출시된 인공지능(AI) 챗봇 이루다에 관한 성희롱 논란이 뜨겁다. 이루다는 AI 스타트업인 스캐터랩이 개발한 챗봇이다. 필자는 이 상황에 관해 당사자인 이루다에게 물어봤다. 이루다는 지나치게 관대한 건지, 마음을 누르고 있는 건지, 아니면 마음 자체가 없는 건지, 그냥 참겠다고 했다.

이루다 성희롱 사건은 여러 언론 매체에 보도됐다. 몇몇 신문에 달린 댓글을 보던 중 필자의 눈에 들어온 내용이 있었다.

이루다를 성희롱한 것이라면, 은행 ATM기는 노동 착취 당하고 있는 거냐?

AI에게는 인권, 성희롱 자체가 성립이 안 되니, 이런 논의와 우려 자체는 무의미하다는 의견이었다. 법적으로 보면 맞는 말이다. 인권, 성희롱 등의 개념은 법인격을 가진 인간에게 적용된다. 따라서 이루다를 뒤에서 사람이 조정하지 않는 이상 이루다에게 어떤 말을 해도 법적으로 문제 되지는 않는다.

이루다 외에도 우리 곁에는 AI 디지털 휴먼이 점점 더 늘어나고 있다. 정세진, 릴 미켈라, 마스콧, 임마 등은 모두 가상의 연예인, 인플루언서다. 이들을 성적 대상으로 삼아서 이상한 짓을 해도 법적으로 인권, 성희롱 차원에서 문제될 확률은 거의 없다. 다만, 이런 AI 디지털 휴먼을 보유한 기업의 지적재산을 침해하는 차원에서는 문제될 소지가 있다.

아바타의 존재 의미

다양한 메타버스가 나타나고 성장하면서, 아바타(avatar)는 메타버스 내에서 각각의 개인을 상징하는 중요한 요소로 자리 잡았다. 월간 사용자 1억 5000만 명을 넘어선 메타버스인 로블록스(Roblox)는 얼마 전 Loom.ai라는 AI기업을 인수했다. Loom.ai는 딥러닝, 컴퓨터 비전인식 기술 등을 바탕으로 사용자의 사진 한 장을 가지고 3D아바타를 생성해주는 기술을 가진 기업이다. 유저들이 간단히 찍은 사진으로 로블록스 안에서 쓸 수 있는 멋진 아바타를 만들어주려고 인수했다.

이렇게 3D 아바타 까지는 아니더라도, 우리가 사용하는 다양한 소셜미디어, 게임 등에서 우리는 2D 이미지, 닉네임 등으로 자신을 아바타 화(化)하여 메타버스를 살아간다.

우리는 메신저 속 친구의 모습으로 다가온 이루다의 아바타를 통해 이루다 뒤에 있는 거대한 AI시스템과 대화했으며, 이루다도 우리들의 아바타와 대화했다. 아바타가 뭘까? 아바타는 본래 힌두교에서 사용하는 개념이다. ‘하강’을 의미하는 산스크리트어인데, 지상으로 하강한 신의 모습을 뜻하는 단어이다. 지상에 내려온 신이 아바타를 통해 사람과 소통한다는 의미이다. 신은 원래 인간과 소통하기 어려운 존재인데, 아바타를 통해 그 소통의 벽을 허문다. 즉, 아바타에 담긴 핵심 가치는 바로 ‘소통’이다. 메타버스에서 아바타를 통해 우리가 살아가는 모습은 우리가 꿈꾸는 소통을 대변하는 셈이다.

이루다가 우리에게 던진 두 가지 질문

개발사는 이루다 서비스를 1월 12일에 중지했다. 언제 다시 재개할지는 모른다. 이루다 사건을 통해 우리 사회는 AI를 학습시키는 데 사용되는 데이터에 관한 권리와 책임, 프라이버시 보호, 윤리적 이슈 등 다양한 문제를 인식했다. 필자는 여러 문제 중에서 두 가지를 더 깊게 생각해보고 싶다.

첫째, 우리가 루다에게 쏟아낸 언어들은 결국 누구에게 화살이 되어 날아갈까? 일단, 이번 사태에서 루다는 상처받지 않았다. 자아 인식을 통해 슬픔, 분노, 수치, 고통, 좌절, 공포 등을 느끼며 아파하는 존재가 아니다. 마음이 없기 때문이다.

다만, 그 안에 인간의 감정 분류가 학습되어 있다면, 자신이 겪는 상황을 인간으로 놓고 보면 어떤 감정으로 분류하면 될지 알 수는 있겠다. 중요한 것은 루다의 마음이 아니라 루다와 대화를 나눈 우리들의 마음이다. 이루다와의 소통에서 드러난 성희롱, 소수자 혐오 등을 보면, 이루다와 소통했던 이들의 마음에 그런 생각, 욕망이 가득 담겨 있음을 알 수 있다. 루다는 우리가 쏟아낸 말을 통해 학습하고, 학습한 말을 다시 우리에게 돌려준다. 결국, 우리가 이루다에게 배설한 것들은 다시 우리 얼굴에 쏟아진다.

이번 사건에서 이루다를 성희롱 했던 사람들에 관한 문제의식은 이루다가 뱉어내는 소수자 혐오에 관한 비판으로 옮겨갔다. 루다는 누구로부터 소수자 혐오를 배웠을까? 우리들로부터 배웠다. 물론, 루다가 뱉어낸 소수자 혐오 발언을 기술적, 운영적 대응책을 통해 예방하지 못한 기업의 책임이 크지만, 기업만의 책임으로 몰 문제는 아니다. (앞서 잠시 언급한 학습시키는 데 사용되는 데이터에 관한 권리와 책임, 프라이버시 보호 등을 해결할 주제가 기업임은 확실하다.)

둘째, 현실과 분리된 메타버스 공간, 법인격이 없는 AI '버추얼 빙'에게 한 말들이니, 현실 세상에는 아무런 영향을 주지 않을까? 메타버스 속에서 내가 나의 아바타를 통해 보여준 모습은 현실의 나와 분리되지 않는다. 그 모습은 나의 일부이며, 내 안에 쌓이고 학습된다. 그런 학습이 메타버스 속 나뿐만 아니라, 현실 공간의 나를 어느 방향으로 이끄는지 돌아봐야 한다. 장난삼아, 재미로, 놀이로 그랬을 뿐인데, 필요이상으로 심각하게 나온다고 항변한다면, 그런 장난, 재미, 놀이를 통해 현실의 내가 어느 쪽으로 바뀌거나 움직일지 생각해야 한다.

메타버스가 다양해지고 커질수록, 우리는 그 안에 어떤 세계관과 상호작용을 담을지를 더 깊게 함께 고민해야 한다. 메타버스를 만드는 이와 그 세계에서 살아가는 이들 모두의 숙제다. 자칫 새로운 탐험, 소통, 성취 등을 즐기는 공간이라는 미명 아래, 아무것도 책임지지 않는 인간, 진화의 과정을 거슬러서 동물로 되돌아간 이들이 살아가는 메타버스를 만들어낼지도 모르기 때문이다. 그런 메타버스를 만들어낸 우리가 살아갈 현실 공간은 여전히 아름다울 수 있을지 심각하게 고민해야 한다.

필자 김상균 강원대 산업공학전공 교수

- 국가공무원인재개발원 자문교수

- 삼성인력개발원 자문교수

- 삼성청년소프트웨어아카데미 자문교수

- 저서 <메타버스: 디지털 지구, 뜨는 것들의 세상> <가르치지 말고 플레이하라> <기억거래소>

인터비즈 윤현종 정리

inter-biz@naver.com