인간이 되려는 로봇의 조건들

로봇이 인간 가치를 학습하기 위한 조건

인공지능 윤리:

인공지능의 윤리적 소프트웨어를 구현하기 위해 어떤 노력이 있었는가?

과거 연구들

웬델 월러치(Wendell Wallach)와 콜린 알렌(ColinAllen)은 [왜 로봇의 도덕인가]에서 공학 윤리, 인공 도덕 행위자 (AMA)에 관한 많은 논의와 접근 방법을 소개한 바 있다.

논리, 사례, 다중 행위자

전통적으로 소프트웨어 개발자는 논리 기반 접근, 사례 기반 접근, 다중 행위자 접근 등을 통해 연구해 왔으며, 주로 의사 결정 지원 시스템에서 구현한 사례들이다.

논리 기반은 하향식 접근으로 규범 논리를 통해 행위자가 무엇을 해야 할지에 관해 추론하도록 허용한다. 코네티컷 대학의 수전 앤더슨과 하트포드 대학의 마이클 앤더슨의 메드에스엑스(MedEthEx)가 그 사례다. 메드에드엑스는 헬스케어 종사자가 윤리적 딜레마에 직면했을 때 가이드를 제공하는 윤리 조언자로 개발했다.

이 시스템은 개념 증명 수준의 개발이었으며, 생의학 윤리에서의 의무와 원리에 기반을 둔다. 자율성 존중, 해악 금지, 자선원리 그리고 정의 원리를 명백한 의무로 제시한다. 그러나 의무가 상충할 때 의료 윤리 전문가가 구체적 사례에 대해 내놓은 판단으로부터 일관된 논리 집합을 추론한다. 사례를 통해 훈련하는데, 전문가가 다양한 의무를 어떻게 비교 평가하는지 추론하고 이를 통해 선택 사항 중 하나를 선택한다.

윤리의 사회적 속성

[인공 도덕: 가상 게임을 위한 도덕적 로봇]이라는 책을 낸 브리티시 컬럼비아 대학의 피터 다니엘슨은 인공 생명체 시뮬레이션을 ‘도덕적 생태계’라고 부르며, 인공 생명체들이 협력하거나 변절하고, 일부는 경쟁자들의 이전 행동에 관한 정보를 저장했다가 이를 이용해 다양한 조건적 협력 전략을 실행할 수 있게 했다. 이는 윤리의 사회적 속성에 대한 접근을 시도한 시뮬레이션으로 생각할 수 있다.

최신 연구와 모델

2016년 아리조나 피닉스에서 열린 미국 인공지능 학회에서는 인공 지능 윤리를 주제로 한 워크숍이 열렸다. 이 중 흥미로운 논문이 두 개가 있다. 하나는 미시간 대학의 벤자민 키퍼스가 발표한 [로봇을 위한 인간 같은 도덕과 윤리]라는 논문이다.

키퍼스의 연구, 헤이트의 ‘사회적 직관주의 모델’에 기반

키퍼스는 자율적 행동을 할 수준의 로봇의 도덕과 윤리를 위한 아키텍처의 아웃라인을 제시하는데, 이는 인지 과학의 연구를 많이 받아들인 내용이다. 그는 공리주의적 접근은 결국 공유지의 비극이나 죄수의 딜레마 같은 나쁜 결과를 산출할 수 있는 한계가 있음을 주장한다.

그는 인간이 가지는 도덕적 판단 모형은 빠르고, 무의식적이면 직관적 대응이 도덕적 판단을 주도하며 그다음에 더 느린 숙의적 추론이 이를 정당화하는 과정이라는 조나단 헤이트의 ‘사회적 직관주의 모델’에 기반을 둔다.

헤이트의 모델에는 빠른 직관적 도덕 반응으로 6개 기반이 있다.

1.배려/피해

2.공정성/부정

3.충성심/배신

4.권위/전복

5.고귀함/추함

6.자유/압제

각각의 기반은 현재 상황에 의해 나타나는 특정한 적응 도전에 대한 반응을 제공하도록 진화한 모듈이다. 각 기반은 특징적 감정 및 관련 미덕과 연계가 되어 있다.

또한, 도덕 학습과 개발은 몇 년 또는 몇십 년에 걸쳐 일어나며 사회의 도덕적 진화는 몇십 년 또는 몇 백 년에 걸쳐서 일어나기 때문에 긴 시간의 경험의 축적을 허용하는 다층의 아키텍처가 필요하다.

축적 결과는 현재 상황에 빠르게 반응할 수 있는 패턴 지향적 규칙으로 축적되어야 한다고 말하며, 이 규칙을 촉발하는 패턴과 관찰하는 상황이 부합될 때 규칙이 대응할 수 있다고 주장한다. 또한, 규칙의 내용과 형태 역시 중요하다.

어떤 사회적 문제가 도덕적 결정으로 이루어지고 이에 대한 정당성을 부여하기 위해서는 더 큰 커뮤니티에 ‘신호’가 보내져야 하고, 이 신호를 다양한 의사 결정자와 판단으로 소통하고 커뮤니티가 어떤 특정인에 관해 판단한다.

세 가지 선결과제

이런 특성을 로봇에게 실용적 가치로 적용하려면 몇 가지 고려할 이슈가 있다.

첫째, 행동 규칙이다. 도로에서 한쪽으로 운전하거나, 사거리에서 정지 후 순서대로 운전하기 위해서는 모든 자동차는 규칙 내에서 협력의 신호를 보낸다.

두 번째는 대응 규칙이다. 6 개의 도덕 기반은 근본적으로 규칙인데, 현재 상황이 패턴에 부합하면 작동한다. 작동함은 즉각적인 감정 대응으로 이것이 상황에 대한 도덕적 평가로 해석된다. 부합 수준은 강화 학습을 위한 보상 신호로 사용할 수 있다.

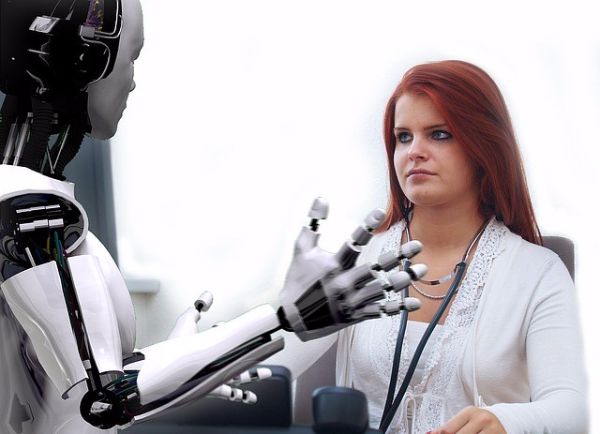

세 번째는 시각 패턴 인식으로 사실 이 부분은 로봇에게 중요한 도전이다. 하나의 이미지를 보고 그 상황이 어떤 시나리오를 말하는 것인지 로봇이 이해하는 것은 매우 어렵다.

아래 그림에서 인간은 학교에서 괴롭힘이라는 것을 대부분 인식하지만, 로봇에게 이 장면이 ‘배려/피해’ 중 어느 상황에 해당하는 것인지 아직 판단할 수준의 기술이 없다.

‘키오테’ 이야기를 이용한 가치 학습

내가 흥미롭게 본 또 다른 논문은 조지아 공대 인터랙티브 컴퓨팅 학부 소속 마크 리들과 브렌트 해리슨이 발표한 [이야기를 이용해 인공 행위자에게 인간 가치를 가르치기]라는 논문이다.

미국 방위고등계획연구국(DARPA)와 해군 연구국의 지원으로 받은 연구로 여러 미디어에서 흥미롭게 다룬 연구이다. 키오테(Quixote)라고 부르는 이 시스템은 로봇이나 인공 행위자(에이전트)가 이야기를 읽고, 각 사건의 바람직한 결과를 학습해, 인간 사회에서 성공적인 행동을 이해하도록 훈련하는 시스템이다.

이런 이야기는 글로 쓰인 것도 많지만, 텔레비전 프로그램이나 영화를 통해서도 제공할 수 있다. 원래 목적과 상관없이 이야기는 이를 생성하는 문화와 사회를 반영하게 된다. 여기에는 사회 문화적 지식, 공통으로 공유하는 지식, 사회적 규약, 정당하거나 정당하지 않은 행동, 역경을 헤쳐나가는 전략 등이 담겨있다.

가치 학습, 강화 학습, 그리고 서사 지능

그러나 아직 현재의 인공지능이 스토리 이해를 완전히 해서 가치 정렬을 할 수 있는 단계가 아니라서, 이들의 연구는 예비적 단계에 불과하다. 이를 위해 가치 학습의 가능성, 행위자의 행동을 제어하기 위한 강화 학습 사용, 내러티브에 대한 계산적 추론 (서사 지능)에 대한 논의를 제시하고 있다.

가치 학습은 지능 개체를 시작부터 내재화하지 못한다면 인간 행동을 관찰하고 이를 통해 학습하자는 것인데, 사람들의 선호를 관찰로 추론한다는 것은 쉬운 일이 아니다. 따라서 앞에서 얘기한 대로 이를 이야기를 통해서 주인공이나 여러 캐릭터가 갖는 특질과 미덕을 배우도록 하자는 것이다.

강화학습은 행동에 따른 보상을 통해 학습의 문제를 푸는 것으로 행위자가 장기적으로 기대 보상을 최대로 얻을 수 있는 최상의 정책을 얻는 것이다. 이미 알파고에서 사용되어 우리에게도 알려진 학습 방식이며 문제 해결과 추계적(Stochastic) 환경에서 장기적 행동을 정하는 데에는 효과적인 방법으로 인정 받는다.

그러나 여기에서는 역강화학습(IRL: Inverse reinforcement learning)을 도입한다. 역강화학습은 어떤 환경에서 다른 행위자(주로 인간)의 행동을 관찰함으로써 보상 함수를 재구성한다. 이는 다른 행위자가 믿을 수 있는 최상의 정책을 사용한다는 가정을 갖는다. IRL은 스튜어트 러셀 등에 의해 가치 학습의 잠재 수단으로 제안되어 왔으며, 이야기를 통해 가치를 학습하는 것이 IRL에서 말하는 방식과 개념적으로 유사하기 때문이다. 그러나 여기에서도 이야기에 나오는 대화를 완전히 이해해야 한다는 문제는 남아 있다.

서사 지능은 이야기를 만들고, 얘기하고, 이해하는 능력이다. 이는 인간이 가진 독특한 능력 중 하나이다. 이미 70년대 부터 이에 대한 연구는 진행되어 왔다. 리들이 그 전에 연구한 세헤라자드가 자동화한 스토리 생성기였다.

저자들은 세헤라자드를 강화 학습과 결합한 모델의 학습이 가치 정렬의 초기 유형을 만들어 낼 수 있음을 설명한다. 그러나 서사로부터 사회문화적 가치를 추출하고 가치 정렬된 보상 신호를 어떻게 구축할 것인 가는 아직 오픈 연구 과제이다.

두 저자는 약국에서 약을 얻을 때 훔치는 것과 줄 서서 기다리고 정중하게 돈을 내고 사는 것을 비교해 후자가 더 많은 보상을 받을 수 있다는 ‘약국 세상’ 모형에서 제한된 실험 결과를 보이지만, 이 방식이 더욱 더 넓고 일반적으로 확대될 수 있을 것으로 본다.

이를 위해 서사 콘텐츠를 크라우드소싱으로 구축하고 그 내용으로 학습할 수 있을 것이라는 기대를 보인다. 그러나 가치 정렬도 인간에게 모든 해악을 방지할 수는 없다. 그러나 문화와 사회에 암묵적 가치에 적응한 인공 지능은 적어도 사이코 같은 외견은 피할 수 있을 것이다.

지금까지 살펴 본대로 아직 인공 지능 윤리를 어떻게 구현했다던가 아니면 실제적이며 구체적인 연구 결과를 보기는 어렵다. 대부분 연구는 매우 작은 문제 안에서 접근했거나, 개념적 수준에 머물고 있다. 그렇지만, 이제 윤리 구현에 대한 많은 논의가 이루어지고 있기 때문에, 3~5년 안에 흥미로운 연구 결과가 나올 수 있을 것으로 생각한다. 그렇지만 그 결과는 아주 제한된 영역일 것이다.

메디치미디어, 2014; 원제: Moral Machines: Teaching Robots Right from Wrong, 2009

M. Anderson, S. Anderson, C. Armen, “MedEthEx: A Prototype Medical Ethics Advisor,” IAAI 2006, AAAI 2006.

McLaren, B.M. (2005). Lessons in machine ethics from the perspective of two computational models of ethical reasoning; Presented at the AAAI Fall 2005 Symposium, Washington, D. C. In Papers from the AAAI Fall Symposium, Technical Report FS-05-06. (pp. 70-77).

Peter Danielson. Artificial Morality: Virtuous Robots for Virtual Games, Routledge, Sept. 1992.

Benjamin Kuipers. 2016. Human-like Morality and Ethics for Robots. In Proceedings of the 2nd International Workshop on AI, Ethics and Society.

Haidt, J. 2012. The Righteous Mind: Why Good People are Divided by Politics and Religion. New York: Vintage Book.

Mark Riedl and Brent Harrison. 2016. Using Stories to Teach Human Values to Artificial Agents. In Proceedings of the 2nd International Workshop on AI, Ethics and Society.

Soares, N. 2015. The value learning problem. Technical Report 2015-4, Machine Intelligence Research Institute.

Russell, S.; Dewey, D.; and Tegmark, M. 2015. Research priorities for robust and beneficial artificial intelli gence. Technical report, Future of Life Institute.

Copyright © 슬로우뉴스.